第一章 走进人工智能——不是科幻,是工具

本章摘要: 本章将帮助初学者建立关于人工智能(AI)的宏观认知框架。我们将穿越 AI 发展的七十年历史长河,厘清人工智能、机器学习、深度学习与生成式 AI 的概念边界,并用通俗易懂的语言解构大语言模型(LLM)的”思考”原理。最后,我们将梳理当前主流的 AI 工具体系,帮助读者根据实际需求选择合适的工具。

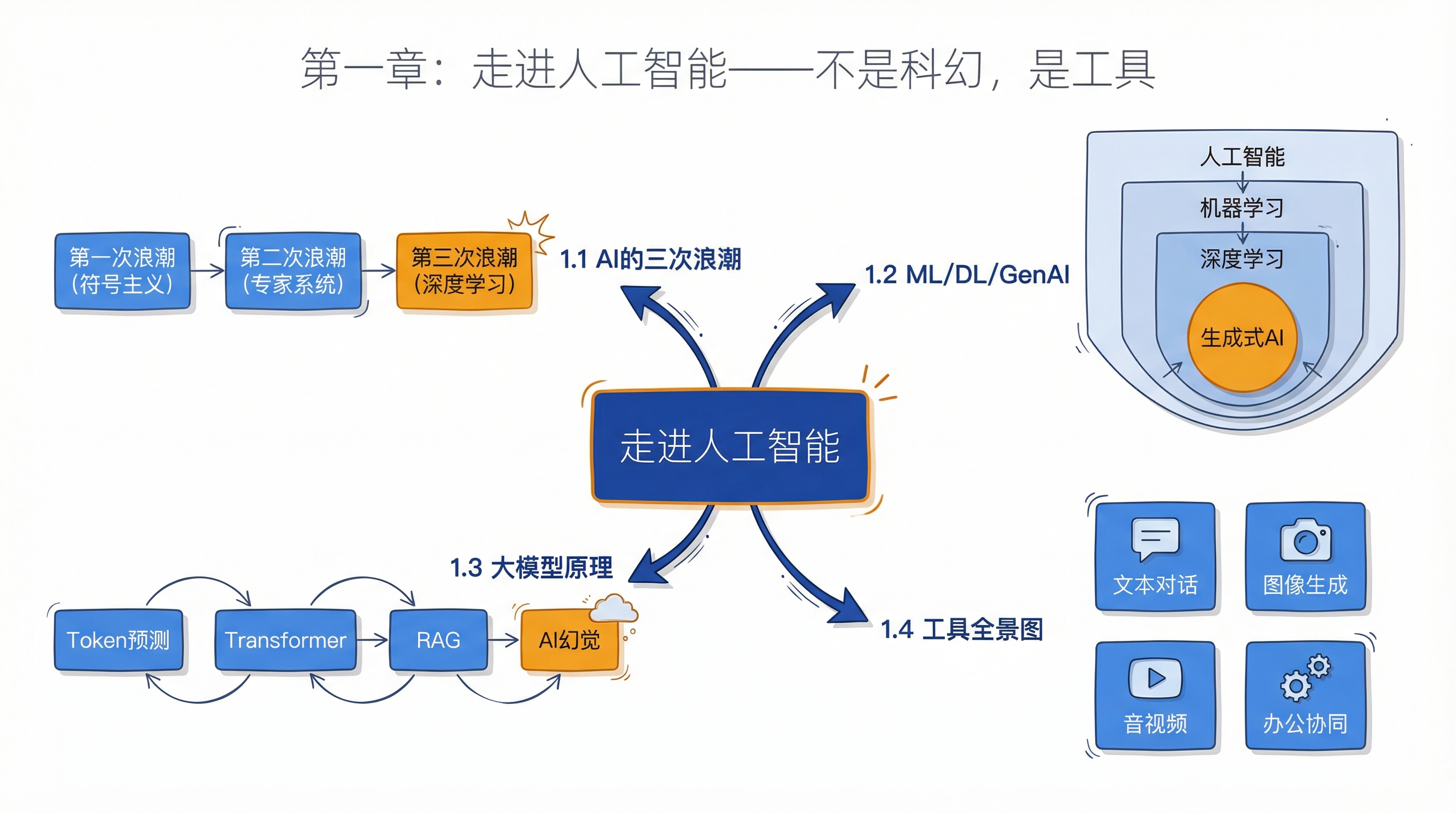

知识图谱

导言:当科幻照进现实

2022 年 11 月 30 日,OpenAI 发布了 ChatGPT。短短两个月,这款对话式人工智能工具的用户数突破一亿,成为人类历史上增长最快的消费级应用。一时间,“人工智能”从实验室走进了每个人的手机屏幕。

然而,围绕 AI 的讨论中充斥着两种极端情绪:一种是”AI 无所不能”的盲目乐观,另一种是”AI 将取代人类”的过度恐惧。这两种认知都源于同一个问题——我们并不真正了解 AI 是什么。

本章将带领读者回到起点,从人工智能的发展历程出发,理清机器学习、深度学习与生成式 AI 之间的关系,用通俗的比喻揭开大模型”思考”的面纱,最后建立一张主流 AI 工具的全景地图。我们的目标不是培养 AI 专家,而是帮助读者建立准确的技术直觉——知道 AI 擅长什么、不擅长什么,从而在后续章节中更好地驾驭它。

学习目标

完成本章学习后,读者将能够:

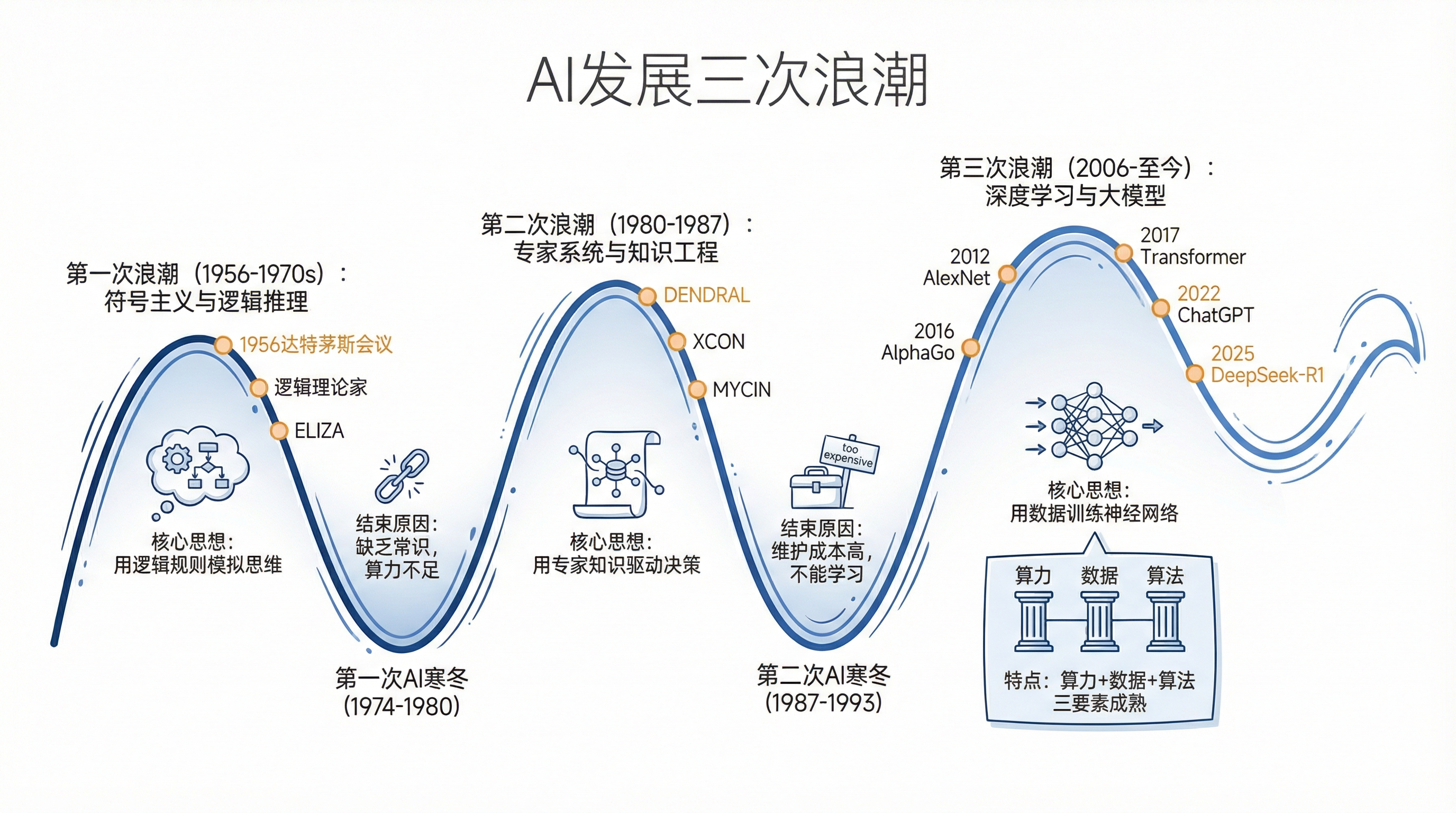

- 复述 人工智能发展的三次浪潮及其代表性技术,理解技术演进的周期性规律;

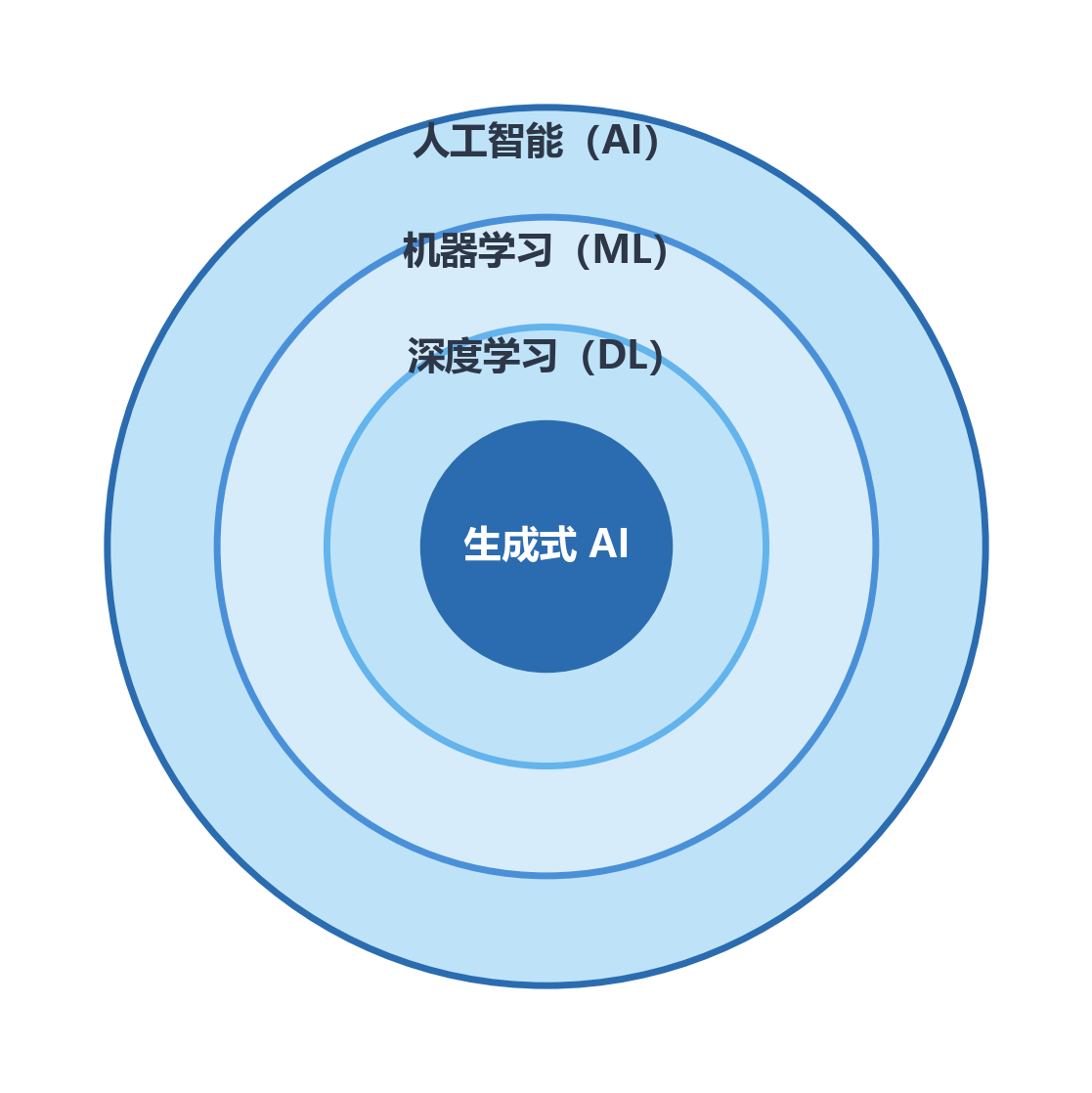

- 辨析 “人工智能 > 机器学习 > 深度学习 > 生成式 AI” 的包含关系,并能举例说明;

- 解释 大语言模型(LLM)的基本工作原理(如 Token 预测、Transformer 机制),并能说明”AI 幻觉”产生的原因;

- 识别 当前主流 AI 工具(如 ChatGPT、DeepSeek、Midjourney 等)的分类与核心功能,并能根据任务需求进行选型。

1.1 AI 的三次浪潮

人工智能并非一夜之间横空出世,而是经历了近七十年的曲折发展。了解这段历史,有助于理解今天的 AI 为何如此强大,也能对它的局限保持清醒。本节将穿越三个时代,看看 AI 是如何从实验室走进每个人的手机的。

一、什么是人工智能

在展开历史之前,我们先回答一个最基本的问题:什么是人工智能?

事实上,创造”像人一样思考的机器”并非现代人的专利,而是人类文明中一个古老的梦想。《列子》中记载了偃师献给周穆王一个能歌善舞的”人偶”;古希腊神话里,工匠之神赫菲斯托斯打造了会自动行走的青铜巨人塔罗斯。从东方到西方,人类对”智慧造物”的想象贯穿了数千年。这种追求的背后,是人类对自身智能本质的好奇——我们究竟是什么?思维能否被复制?正是这种好奇心,最终在20世纪中叶催生了人工智能这门学科。

简单来说,人工智能(Artificial Intelligence, AI)是指由人类设计的、能够模拟人类智能行为的计算机系统。这里的”智能行为”包括四种核心能力:

感知:看懂图片、听懂语音;

推理:分析信息、做出判断;

学习:从经验中不断改进;

决策:在多个选项中选择最优方案。

但有一点必须明确:AI 是一种工具,不是一种生命。它没有意识、没有情感、没有自主意愿。当我们说 AI”思考”或”理解”时,使用的是比喻性说法——它实际上是在执行数学运算。可以把它想象成一个极其高效的计算器:它能处理的问题远比普通计算器复杂,但本质上仍然是在”算”,而不是在”想”。

二、第一次浪潮:符号主义与逻辑推理(1956—1970s)

1. 前史:图灵与”模仿游戏”

在 AI 正式诞生之前,英国数学家艾伦·图灵(Alan Turing)已经为它奠定了思想基础。1950 年,图灵发表了著名论文《计算机与智能》,提出了”模仿游戏”——后来被称为”图灵测试”。有趣的是,这个测试的原始版本并非人与机器对话,而是需要三个参与者:一个男人(A)、一个女人(B)和一个提问者(C)。C 需要通过打字机提问来判断哪个是男人、哪个是女人。图灵进而提出:如果用机器替换 A 的角色,提问者还能分辨吗?这才是”图灵测试”的原型。

更早在 1948 年,图灵就为英国国家物理实验室撰写了一份名为《智能机器》的内部报告,首次提出了神经网络和进化的概念。这篇报告直到 1969 年才发表,但被现代机器人专家罗德尼·布鲁克斯认为是 AI 两条路线分歧的原点。

延伸阅读:1951 年,马文·明斯基与邓恩·埃德蒙建造了世界上第一台神经网络计算机 SNARC(随机神经模拟强化计算器),这比 AI 正式命名还早了五年。

2. 达特茅斯会议:AI 的”出生证明”

1955 年,约翰·麦卡锡(John McCarthy)联合马文·明斯基、纳撒尼尔·罗切斯特(IBM)和克劳德·香农(贝尔实验室),向洛克菲勒基金会提交了一份研究建议书。麦卡锡的原始预算是 13,500 美元,但基金会最终只批了 7,500 美元。

1956 年夏天,10 位核心科学家齐聚达特茅斯学院,召开了这场载入史册的研讨会。除了四位发起人,还包括艾伦·纽厄尔、赫伯特·西蒙、亚瑟·塞缪尔等人。会上,麦卡锡提出了”人工智能”(Artificial Intelligence)这一术语——尽管他晚年承认这个词可能是从别人那里听来的,纽厄尔和西蒙当时更喜欢用”复杂信息处理”这个说法。

趣闻:这次会议上给所有人留下最深印象的,是纽厄尔和西蒙带来的程序”逻辑理论家”(Logic Theorist)。它成功证明了《数学原理》中 38 条定理。但当他们把论文投给《符号逻辑杂志》时,却被退稿,理由是”把一本过时的逻辑书里的定理用机器重证一遍没啥意思”。

3. 核心理念:用符号模拟思维

这一时期的主流思想是符号主义(Symbolism)。研究者认为,人类的思维本质上是对符号的逻辑运算——就像数学家用公式推导定理一样。因此,只要把知识编码为符号,再编写推理规则,计算机就能”思考”。

基于这一理念,科学家们开发出了一系列令人兴奋的成果:

逻辑理论家(Logic Theorist, 1956):能够自动证明数学定理,被称为”第一个 AI 程序”;

通用问题解决器(GPS, 1957):试图用统一的方法解决各类问题;

ELIZA(1966):第一个聊天机器人,能通过简单的模式匹配与人对话。

4. 感知机之争与第一次 AI 寒冬(1974—1980)

在符号主义蓬勃发展的同时,另一条路线也在悄然生长。1957 年,弗兰克·罗森布拉特(Frank Rosenblatt)提出了”感知机”(Perceptron)模型——一种模仿神经元的简单网络,能够学习识别简单的图案。这一成果引发了巨大的热潮。

然而,1969 年,明斯基和佩珀特出版了《感知机》一书,从数学上证明了单层感知机无法解决”异或”(XOR)问题——即无法处理非线性分类。这本书直接导致神经网络研究进入了长达 20 年的”大饥荒”时期。

趣闻:明斯基和罗森布拉特其实是布朗克斯科学高中的同学(明斯基高一级),两人彼此认识且互相竞争。罗森布拉特后来在 1971 年 43 岁生日当天划船溺水身亡。

与此同时,符号主义也遭遇了致命缺陷:机器缺乏常识。人类看到”他把冰淇淋放在口袋里,到家后发现口袋湿了”这句话,立刻能理解冰淇淋融化了。但符号主义 AI 需要有人事先把”冰淇淋在体温下会融化”“融化的液体会弄湿布料”等无数条常识逐一编写为规则,否则无法做出推断。

现实世界的常识几乎是无穷的,不可能全部手工编码。加之当时计算机算力严重不足,各国政府纷纷削减 AI 研究经费,人工智能进入了第一个”寒冬”。

知识拓展:莫拉维克悖论 20 世纪 80 年代,研究者发现了一个反直觉的现象:人类觉得”困难”的事情(如数学推理、下棋),对计算机来说反而容易;而人类觉得”简单”的事情(如走路、识别人脸、理解笑话),对计算机来说却极其困难。这就是”莫拉维克悖论”——困难的问题容易解决,简单的问题很难解决。

□ 术语卡片 > 符号主义(Symbolism):人工智能早期的主流学派,主张用逻辑符号和推理规则来模拟人类思维。优点是推理过程透明可解释,缺点是难以处理模糊、不确定的现实问题。

三、第二次浪潮:专家系统与知识工程(1980—1987)

1. 从”通用智能”到”专业知识”

经历了第一次寒冬后,研究者意识到:与其追求”什么都懂”的通用智能,不如先让机器成为某个领域的”专家”。这一思路催生了专家系统(Expert Systems)——一种将特定领域专家的知识编码为规则库,再配合推理引擎进行决策的程序。

2. 代表性成果

DENDRAL(1968):斯坦福大学的费根鲍姆与遗传学家李德伯格、化学家翟若适合作开发,用于分析质谱仪数据以确定物质的分子结构,是第一款真正意义上的专家系统;

XCON 系统:卡内基梅隆大学为 DEC 公司(数字设备公司)开发的计算机配置专家系统,用于自动配置 VAX 系列计算机的零部件,据称每年为 DEC 节省约 4000 万美元,是专家系统商业化的巅峰;

MYCIN:用于细菌感染诊断的医疗专家系统,诊断准确率甚至超过了部分人类医生。

爱德华·费根鲍姆(Edward Feigenbaum)因在这一领域的开创性贡献,被誉为”专家系统之父”。

3. 日本的教训与第二次 AI 寒冬(1987—1993)

专家系统虽然在特定领域表现出色,但暴露出三个严重问题:

维护成本高昂:知识库需要人工持续更新,一旦领域知识发生变化,整个系统可能需要重写;

缺乏学习能力:专家系统不能从新数据中自动学习,无法”举一反三”;

脆弱性:一旦遇到规则库未覆盖的情况,系统就会束手无策。

1982 年,日本通产省投入约 8.5 亿美元启动”第五代计算机”计划,目标是制造能像人一样推理、对话的机器。该计划主要押注于 Prolog 语言和逻辑编程,但最终因未能交付具有实际商业价值的成果而失败,加速了第二次 AI 寒冬的到来。

随着个人电脑性能超越昂贵的专用 AI 硬件,AI 硬件市场崩盘,人工智能再次进入寒冬。

□ 术语卡片 > 专家系统(Expert System):一种模拟人类专家决策能力的计算机程序,由知识库(存储领域知识)和推理引擎(执行逻辑推理)两部分组成。它是 AI 第二次浪潮的代表性技术。

四、第三次浪潮:深度学习与大模型时代(2006—至今)

1. 连接主义的全面回归

与符号主义不同,连接主义(Connectionism) 主张模仿人脑的神经元结构,通过大量数据训练让神经网络自动学习特征,而非人工编写规则。这一思想早在 1943 年就已萌芽,但受限于算力和数据,长期未能实现突破。

转折点出现在 2006 年。杰弗里·辛顿(Geoffrey Hinton)在《科学》杂志发表论文,提出了”深度信念网络”和逐层预训练方法,解决了深层神经网络难以训练的技术瓶颈,深度学习(Deep Learning) 时代由此开启。

2. 关键里程碑

表1-1 第三次AI浪潮关键里程碑

| 年份 | 事件 | 意义 |

|---|---|---|

| 2012 | AlexNet 在 ImageNet 竞赛中将错误率从 26% 降至 15% | 深度学习在图像识别领域的决定性胜利 |

| 2016 | AlphaGo 以 4:1 战胜围棋世界冠军李世石 | 深度强化学习+蒙特卡洛树搜索的突破,引发全球关注 |

| 2017 | 谷歌发表论文提出 Transformer 架构 | 奠定了大语言模型的技术基础 |

| 2022 | OpenAI 发布 ChatGPT | 生成式 AI 走向大众,标志着大模型时代的全面到来 |

| 2024 | Sora 文生视频模型发布 | AI 从文本生成扩展到高质量视频生成 |

| 2025 | DeepSeek-R1 开源发布,推理能力比肩闭源模型 | 证明开源模型可达到前沿水平,大幅降低 AI 使用门槛 |

| 2025—2026 | Gemini 3、Claude Opus 4.6 等新一代模型涌现 | 多模态、长上下文、Agent 能力成为标配,AI 从”对话”走向”行动” |

趣闻:AlphaGo 的后续版本 AlphaGo Zero 仅通过自我对弈(完全不依赖人类棋谱),就以 100:0 的战绩击败了之前的版本。这说明在某些领域,AI 通过自我学习能超越人类经验的上限。

中国力量:在这一轮全球 AI 竞赛中,中国团队正在从”跟跑”走向”并跑”乃至”领跑”。2025 年初,深度求索(DeepSeek)以极低的训练成本发布了推理能力比肩国际顶尖闭源模型的 R1,并选择完全开源,引发全球关注。与此同时,通义千问(Qwen)、智谱 GLM 等国产大模型也在多项国际评测中名列前茅。这些成就背后,是中国在算力基础设施、海量中文数据和工程化能力上的长期积累。作为新时代的大学生,我们既是这些技术成果的受益者,也肩负着推动中国 AI 持续创新的责任。

3. 为什么这次不一样?

第三次浪潮之所以持续至今且不断加速,得益于三个条件的同时成熟:

算力爆发:GPU(图形处理器)的并行计算能力为训练大规模神经网络提供了硬件基础;

数据洪流:互联网产生的海量文本、图像、视频数据为模型训练提供了充足的”养料”;

算法突破:Transformer 架构的提出,使模型能够高效处理长序列数据,大幅提升了语言理解和生成能力。

4. 深度学习三巨头

杰弗里·辛顿(Geoffrey Hinton)、杨立昆(Yann LeCun)和约书亚·本希奥(Yoshua Bengio)因在深度学习领域的奠基性贡献,共同获得了 2018 年图灵奖——这是计算机科学的最高荣誉。

□ 术语卡片 > 深度学习(Deep Learning):机器学习的一个分支,使用多层人工神经网络从数据中自动学习特征。“深度”指的是网络的层数多,而非理解的深度。它是当前 AI 技术的核心驱动力。

本节小结

人工智能的发展并非一帆风顺,而是经历了”热潮—寒冬—再热潮”的螺旋式上升。

下表概括了三次浪潮的核心特征:

表1-2 三次AI浪潮对比概览

| 浪潮 | 时间 | 核心思想 | 代表技术 | 局限 |

|---|---|---|---|---|

| 第一次 | 1956—1970s | 符号主义:用逻辑规则模拟思维 | 定理证明、ELIZA | 缺乏常识,算力不足 |

| 第二次 | 1980—1987 | 知识工程:用专家知识驱动决策 | 专家系统 | 维护成本高,不能学习 |

| 第三次 | 2006—至今 | 连接主义:用数据训练神经网络 | 深度学习、大模型 | 需要海量数据和算力 |

理解这段历史,我们就能明白一个关键事实:AI 的每一次进步,都不是因为机器变得”更聪明”了,而是因为人类找到了更好的方法来利用数据和算力。 AI 始终是工具,而非智慧本身。

思辨时刻:“中文屋”实验——机器真的在”理解”吗?

1980 年,哲学家约翰·塞尔提出了著名的”中文屋”思想实验:假设一个完全不懂中文的人被关在一间屋子里,屋里有一本详尽的规则手册。外面的人用中文写纸条递进来,屋里的人按照手册查找对应的规则,写出中文回答递出去。从外面看,这间屋子”懂中文”;但屋里的人其实一个字都不理解。

塞尔认为,计算机就像这个屋子里的人——它能按规则处理符号并给出正确回答,但并不真正”理解”符号的含义。这个实验至今仍是 AI 哲学中最重要的争论之一:AI 的”智能”是真正的理解,还是精巧的模拟?

思考与讨论

- 回顾 AI 的两次”寒冬”,试分析第三次浪潮是否也会遭遇类似的低谷,并说明理由。

- 符号主义强调”规则”,连接主义强调”数据”,未来的 AI 更可能走哪条路线?请阐述观点。

- 如何看待”中文屋”实验?当 AI 能流畅地与人对话时,它是在”理解”还是在”模拟”?

1.2 机器学习、深度学习与生成式 AI

人工智能、机器学习、深度学习、生成式 AI——这些词经常被混用,但它们并不是同一回事。理清这四个概念的层次关系,是理解当代 AI 技术的第一步。

一、四层同心圆:从大到小的包含关系

这四个概念之间是层层嵌套的包含关系,可以用同心圆来理解:

人工智能是最大的范畴,泛指一切模拟人类智能的技术;

机器学习是实现人工智能的主要方法之一,强调让机器从数据中学习;

深度学习是机器学习的一种特殊技术,使用多层神经网络;

生成式 AI是深度学习的一类应用方向,专注于创造新内容。

下面逐一展开。

二、机器学习:从数据中”找规律”

机器学习(Machine Learning, ML) 的核心思想可以用一句话概括:不是告诉计算机”怎么做”,而是让计算机从数据中自己”学会做”。

传统编程的逻辑是:程序员编写规则,计算机执行规则。例如,要判断一封邮件是否为垃圾邮件,程序员需要手动列出所有可能的特征(包含”中奖”一词、发件人不在通讯录中……)。

机器学习的逻辑则相反:给计算机大量已标注的邮件样本(“这封是垃圾邮件”“这封不是”),让算法自动从中发现规律。学习完成后,机器就能对新邮件做出判断。

用一个更直观的例子来理解:我们怎么教三岁的孩子认苹果?一种方式是告诉他规则——“红色的、圆的、有柄的就是苹果”(这是1.1节提到的符号主义思路)。但实际上,大多数孩子是通过反复看到各种各样的苹果——红的、绿的、大的、小的——自己”悟”出什么是苹果(这正是机器学习的思路)。机器学习走的就是后一条路:不靠人写规则,而是靠数据”喂”出能力。

机器学习的三种主要方式:

表1-3 机器学习的三种主要方式

| 学习方式 | 类比 | 说明 | 典型应用 |

|---|---|---|---|

| 监督学习 | 老师批改作业 | 用带标签的数据训练,告诉机器”正确答案” | 垃圾邮件识别、图像分类 |

| 无监督学习 | 自己整理书架 | 数据没有标签,让机器自己发现数据中的结构 | 用户分群、异常检测 |

| 强化学习 | 训练宠物 | 通过奖励和惩罚让机器在试错中学习最优策略 | 游戏 AI、机器人控制 |

阅读材料:泰坦尼克号生存预测

《人工不智能》一书中介绍了一个经典的机器学习案例:用泰坦尼克号乘客数据(年龄、性别、船舱等级等)训练模型,预测哪些乘客更可能在海难中幸存。结果显示,“女性”“头等舱”是最强的生存预测因子——这并非 AI 的”发现”,而是数据忠实地反映了当时”妇女儿童优先”的逃生规则和阶级差异。这个案例提醒我们:机器学习找到的”规律”,本质上是数据中已有模式的数学表达,而非独立的”思考”。

思政融入:科学精神与求真务实:泰坦尼克号案例揭示了一个重要道理——数据不会”说谎”,但数据也不会”思考”。机器学习的结论取决于数据本身的质量和代表性。这提醒我们,在使用 AI 时必须秉持实事求是的科学态度:不迷信工具的输出,不放弃独立的判断,始终追问”数据从哪里来”“结论是否可靠”。这种求真务实的精神,既是科学素养的核心,也是每一位合格公民应有的品质。

三、深度学习:模仿大脑的神经网络

深度学习(Deep Learning, DL) 是机器学习的一个分支,它使用多层人工神经网络来处理数据。“深度”指的是网络层数多(通常数十层甚至上百层),而非理解的深度。

深度学习与传统机器学习的关键区别:

表1-4 传统机器学习与深度学习对比

| 对比维度 | 传统机器学习 | 深度学习 |

|---|---|---|

| 特征提取 | 需要人工设计特征(如”猫有胡须、尖耳朵”) | 自动从原始数据中学习特征 |

| 数据需求 | 小数据集即可工作 | 通常需要海量数据 |

| 计算资源 | 普通计算机即可 | 通常需要 GPU 加速 |

| 可解释性 | 较好,能说明决策依据 | 较差,常被称为”黑盒” |

| 擅长领域 | 结构化数据(表格、数值) | 非结构化数据(图像、语音、文本) |

打个比方:如果要教机器识别猫的照片,传统机器学习需要人类先告诉机器”猫有什么特征”(人工特征工程),而深度学习只需要给机器看大量猫的照片,它会自己学会识别——先学会识别边缘,再学会识别纹理,最后学会识别整体形态。这种端到端学习的能力,正是深度学习的核心优势。

用一个形象的比喻来说 [1]:深度学习 = “深度”(层数多)+ “学习”。输入层和输出层中间有一个”黑盒子”(隐藏层),就像人脑把视觉信号层层传递,最终认出”这是一只猫”。

四、生成式 AI:从”找规律”到”创造内容”

传统的 AI 大多是判别式的——就像一台照相机,只能识别已有的东西(“这张照片里是猫”)。而生成式 AI(Generative AI) 则走向了另一个方向:它像神笔马良,能创造从未存在过的新内容(“画一只穿太空服的猫”)。

给它一段文字描述,它能生成一幅画(文生图);

给它一个主题,它能写出一篇文章(文本生成);

给它一段旋律提示,它能谱出一首完整的歌曲(音乐生成)。

生成式 AI 的核心技术基础是大规模预训练模型(简称”大模型”)。这些模型通过学习互联网上海量的文本、图像等数据,掌握了语言的统计规律和视觉的生成模式,从而能够”预测”下一个词或下一个像素,实现内容的生成。

当前最具代表性的生成式 AI 技术包括:

表1-5 当前主流生成式AI技术方向

| 技术方向 | 代表模型 | 能力 |

|---|---|---|

| 大语言模型(LLM) | GPT 系列、DeepSeek、文心一言 | 文本理解与生成 |

| 扩散模型(Diffusion) | Stable Diffusion、Midjourney | 图像生成 |

| 多模态模型 | GPT-4o、Gemini | 同时处理文本、图像、音频 |

□ 术语卡片 > AIGC(AI Generated Content):即”人工智能生成内容”,泛指由 AI 自动生成的文本、图像、音频、视频等各类内容。它是生成式 AI 的产出物,与 UGC(用户生成内容)、PGC(专业生成内容)并列,构成了内容生产的三种模式。

五、动手体验:用 DeepSeek 感受”机器学习”

理论讲了不少,现在让我们动手体验一下。不需要写代码,只需要打开 DeepSeek,就能直观感受机器学习中”分类”任务的逻辑。

任务目标:让 AI 扮演一个”分类模型”,根据特征判断水果类型。

第 1 步:打开 DeepSeek(https://chat.deepseek.com),输入以下提示词:

现在请你扮演一个水果分类模型。我会给你一些水果的特征描述,

你需要根据特征判断它是什么水果,并解释你的"推理过程"

(即你依据了哪些特征做出判断)。

特征描述:

- 水果 A:圆形,红色,直径约 8cm,表面光滑,有短柄

- 水果 B:长条形,黄色,长约 20cm,需要剥皮食用

- 水果 C:圆形,橙色,直径约 7cm,表面有粗糙纹理,需要剥皮第 2 步:观察 AI 的输出。 DeepSeek 的回答示例:

水果 A → 苹果 推理依据:圆形 + 红色 + 光滑表面 + 短柄,这些特征组合高度匹配苹果的典型外观。

水果 B → 香蕉 推理依据:长条形 + 黄色 + 需要剥皮,这是香蕉最显著的特征组合。

水果 C → 橙子 推理依据:圆形 + 橙色 + 粗糙纹理 + 需要剥皮,符合橙子的典型特征。

第 3 步:理解这个演示与机器学习的关系。

在这个演示中,AI 做的事情和机器学习中的”分类器”非常相似: 输入特征:形状、颜色、大小、表面质感(对应机器学习中的”特征向量”)

输出类别:苹果、香蕉、橙子(对应机器学习中的”标签”)

推理依据:AI 解释了它依据哪些特征做出判断(对应机器学习中的”特征权重”)

真正的机器学习模型不会用自然语言推理,而是通过数学计算来完成这个过程。但核心逻辑是一样的:从特征中找规律,用规律做预测。

可以继续追问 AI:“如果我给你一个新的水果特征——椭圆形、绿色、表面有细小凸起、切开后是红色果肉,你会判断它是什么?”观察 AI 能否正确识别出西瓜。

六、一个比喻串起四个概念

如果把人工智能比作交通工具这个大类:

机器学习就是”引擎技术”——让交通工具能够自主运转的核心动力;

深度学习就是”喷气式引擎”——更强劲、更复杂,能处理更高难度的任务;

生成式 AI就是”装载了喷气式引擎的新型飞机”——它不仅能飞(识别、分析),还能在空中表演特技(创造、生成)。

本节小结

本节涉及的核心概念总结如下:

表1-6 核心概念速查

| 概念 | 一句话定义 | 核心能力 |

|---|---|---|

| 人工智能 | 模拟人类智能的技术总称 | 感知、推理、学习、决策 |

| 机器学习 | 让机器从数据中自动学习的方法 | 从数据中发现规律 |

| 深度学习 | 用多层神经网络自动提取特征 | 处理图像、语音、文本等复杂数据 |

| 生成式 AI | 基于大模型创造新内容 | 生成文本、图像、音视频 |

理解了这四个概念的层次关系,我们就有了一张清晰的”技术地图”。接下来,我们将深入大模型的内部,看看它究竟是如何”思考”的。

1.3 大模型是怎么”思考”的

向 ChatGPT 提问时,屏幕上的文字一个接一个地蹦出来——它究竟在做什么?本节将用通俗的比喻,揭开大语言模型工作原理的面纱。

一、Token 预测:逐字”猜”出答案

大语言模型(Large Language Model, LLM)的核心工作方式,可以用一个词来概括:预测。

具体来说,当输入”今天天气真”这四个字时,模型会根据它在训练中学到的语言规律,计算下一个字最可能是什么。它可能给出这样的概率分布:

“好” → 62%

“不” → 18%

“热” → 12%

其他 → 8%

模型选择概率最高的”好”作为输出,然后把”今天天气真好”作为新的输入,继续预测下一个字……如此循环,直到生成完整的回答。

这里有一个关键概念:Token。模型并不是以”字”为单位处理文本的,而是以 Token 为单位。一个 Token 可能是一个汉字、一个英文单词,也可能是一个词的一部分。例如,“人工智能”可能被拆分为”人工”和”智能”两个 Token。

但模型看到的并不是文字本身,而是一串”数字密码”——这就是词嵌入(Word Embedding)。有学者将其比喻为“带属性的乐高积木” [1]:

“猫”和”狗”的积木因为都有”动物”“毛绒绒”的属性,所以能吸在一起(在向量空间中距离近);

“苹果”的积木因为属性不同,会排斥它们(距离远);

机器看到的不是文字,而是一串数字向量,如 [0.9, 0.8, 0.1…]。

模型在预测下一个词时,还有不同的”策略”可以选择:

Top-k 采样(“糖果抽奖箱”):只从概率最高的 K 个候选词中随机选择,防止选到奇怪的词;

Top-p 采样(“神奇扭蛋机”):累积概率达到某个阈值就停止选择,是一个动态筛选过程;

温度参数(“想象力开关”):调低温度像严谨的科学家(适合写报告),调高温度像疯狂的艺术家(适合编故事)。

提示:温度、Top-k、Top-p 等参数通常由平台预先配置,普通用户在网页对话界面中无需手动调节。理解这些原理的意义在于:它帮助你理解”为什么同一个问题,每次问 AI 得到的回答都不完全一样”。

□ 术语卡片 > Token:大语言模型处理文本的基本单位。模型将输入文本切分为 Token 序列进行计算。中文通常一个字对应 1—2 个 Token,英文一个单词对应 1—3 个 Token。模型的”上下文窗口”(如 128K Token)决定了它一次能处理的文本长度上限。

二、Transformer:一座”超级积木工厂”

大语言模型之所以能如此准确地预测下一个词,核心秘密在于一种名为 Transformer 的神经网络架构。它由谷歌团队在 2017 年提出,论文标题是那句著名的 “Attention Is All You Need”(注意力就是你所需要的一切)。

有一个生动的比喻 [1]:Transformer 就像一座“超级积木工厂”,专门生产会讲故事的机器人。这座工厂有三个核心部件:

部件一:魔法积木块——自注意力机制(Self-Attention)

工厂里有一种”魔法积木块”,它拥有两项超能力:

“看全局”:它能立刻感知到句子中所有词语之间的关系。例如读到”猫追老鼠”时,它知道”猫”和”追”有关(谁在动?),“追”和”老鼠”有关(追什么?)。

“记重点”:它会自动给重要的词贴上”金色标签”,给不太重要的词(如”的”“了”)贴上”灰色标签”。

用技术语言来说,自注意力机制让模型在处理每一个词时,都能”回头看”整个句子,计算当前词与其他所有词的关联强度。这就是为什么大模型能理解”苹果”在”我吃了一个苹果”和”苹果发布了新手机”中的不同含义——因为它会根据上下文中的其他词来判断”苹果”的意思。

注意力可视化:直观感受 AI 的”目光”

如果我们能”看到”注意力机制的工作过程,会是什么样子?研究者开发了注意力可视化工具,可以用颜色深浅来表示词与词之间的关联强度。以”小猫坐在垫子上,它很舒服”这句话为例:

可以看到:当模型处理”它”这个字时,注意力最强烈地指向了”小猫”——模型”知道”“它”指的是小猫。当处理”舒服”时,注意力同时指向”它”和”小猫”——模型理解了是小猫感到舒服。这种”回头看”的能力,正是自注意力机制的精髓。

部件二:分工小工人——多头注意力(Multi-Head Attention)

工厂里不止一个工人在观察,而是有多个小工人同时从不同角度找线索:

工人 A 负责找”谁在做什么”(猫 → 追);

工人 B 负责找”动作和谁有关”(追 → 老鼠);

工人 C 负责找”时间地点”(昨天、在花园)。

最后,把所有工人的发现拼在一起,机器人对信息的理解就更加全面。这就是”多头”的含义——多个注意力”头”并行工作,各司其职,避免遗漏重要线索。

部件三:顺序贴纸——位置编码(Positional Encoding)

语言是有顺序的。“猫咬狗”和”狗咬猫”用了完全相同的词,但意思截然不同。工厂通过给每个积木贴上“荧光数字贴纸”来解决这个问题:

给”猫”贴 1 号,“咬”贴 2 号,“狗”贴 3 号;

机器人检查贴纸,就能明白”1 → 2 → 3”的顺序,知道是谁咬了谁。

这种位置编码使用了特殊的数学公式(正弦和余弦函数),就像给数字打上不同颜色的光,让机器人一眼就能识别每个词的位置。

□ 术语卡片 > Transformer:2017 年由谷歌提出的神经网络架构,通过自注意力机制实现对序列数据的高效并行处理。它是 GPT、BERT、DeepSeek 等几乎所有主流大语言模型的技术基础。

三、RAG:给 AI 一场”开卷考试”

大模型虽然强大,但有一个天然的短板:它的知识是”冻结”在训练数据中的。如果问它 2025 年的新闻事件,而它的训练数据截止到 2024 年,它就可能给出过时甚至错误的回答。

为了解决这个问题,工程师们发明了 RAG(Retrieval-Augmented Generation,检索增强生成) 技术。

有一个贴切的比喻 [1]:普通的大模型就像一个“闭卷考试”的学生,只能靠记忆答题;而加了 RAG 的大模型,则像参加“开卷考试”——遇到问题先翻书,再作答。

RAG 的工作流程:

举个例子:当问到”2024 年巴黎奥运会的吉祥物是什么?”

没有 RAG 的模型(闭卷):可能凭记忆猜测”熊猫?“——答错了;

有 RAG 的模型(开卷):先从知识库中检索到相关资料,找到正确答案”弗里吉”,再组织语言回答。

RAG 的核心价值在于:不需要重新训练模型(相当于不用重新上学),只需要更换或更新知识库(相当于换一本参考书),就能让模型获得最新、最准确的知识。

□ 术语卡片 > RAG(检索增强生成):一种将信息检索与文本生成相结合的技术。模型在生成回答前,先从外部知识库中检索相关信息,再基于检索结果生成更准确的回答。它是当前解决大模型”知识过时”和”事实错误”问题的主流方案。

四、AI 幻觉:“自信的鹦鹉”

在使用 AI 工具时,可能遇到过这样的情况:AI 一本正经地给出一个”事实”,但经过核查后发现完全是编造的。这种现象被称为 AI 幻觉(Hallucination)。

有学者将这一现象比喻为一只“爱撒谎的鹦鹉” [1]:

如果教鹦鹉”苹果是红色的”,它能正确重复;

但如果问它没学过的问题,比如”恐龙怎么玩手机?“,它不会说”我不知道”,而是会自信地编造一个答案——因为它的本能就是”说点什么”。

AI 幻觉产生的根本原因:

大语言模型的本质是概率预测——它总是选择”最可能的下一个词”,而不是”最正确的下一个词”。当模型遇到训练数据中未充分覆盖的问题时,它会基于统计规律”猜”出一个看似合理但实际错误的答案。就像考试遇到不会的题,硬编一个答案交上去。

如何应对 AI 幻觉:

- 多源验证:AI 给出的关键信息,务必通过其他渠道核实;

- 溯源查证:要求 AI 提供信息来源,并亲自验证来源的真实性;

- 使用 RAG:让 AI 基于可靠的知识库回答,而非纯粹依赖记忆;

- 保持警觉:越是流畅、自信的回答,越要警惕其中可能存在的错误。

□ 术语卡片 > AI 幻觉(Hallucination):指 AI 模型生成的内容看似合理、表述流畅,但实际上包含事实性错误或完全虚构的信息。这是当前所有大语言模型的共性问题,源于其基于概率生成文本的工作机制。

五、大模型是怎么”学习”的:从上学到实习

大模型的训练过程可以类比为一个人从上学到工作的成长历程:

第一阶段:预训练——“填空游戏”

模型使用海量通用数据(维基百科、新闻、书籍等)进行学习。就像给一个小机器人一本没有答案的厚书,遮住部分字让它猜(例如”___喜欢吃鱼”,猜”猫”)。猜对了大脑亮灯,猜错了调整参数。经过数万亿次的”填空”练习,模型建立起了一个庞大的”常识电池”。

第二阶段:微调——“学习新技能”

预训练让模型掌握了通用常识,微调则是教它特定的技能。就像把一个懂常识的大学毕业生,专门培训成医生或律师。通过在特定领域的数据上继续训练,模型能在该领域表现得更加专业。

第三阶段:RLHF——“训练小狗”

最后一步是让人类对模型的回答进行打分排序。做对了(回答符合人类价值观)就给奖励,做错了(说脏话、有偏见)就批评。这让 AI 不仅”聪明”,而且”懂规矩”。

本节小结

表1-7 大模型核心概念速查

| 概念 | 通俗比喻 | 核心要点 |

|---|---|---|

| Token 预测 | 逐字填空 | 模型通过预测”下一个最可能的词”来生成文本 |

| Self-Attention | 魔法积木块 | 让模型理解词与词之间的关联 |

| Multi-Head Attention | 分工小工人 | 多个”专家”从不同角度同时分析 |

| Positional Encoding | 顺序贴纸 | 让模型理解词语的先后顺序 |

| RAG | 开卷考试 | 先检索知识库,再生成回答 |

| AI 幻觉 | 自信的鹦鹉 | 模型可能编造看似合理的错误信息 |

理解了这些原理,就不会再把 AI 当作”无所不知的神谕”,而是将它视为一个强大但需要监督的助手——它能帮助高效完成任务,但最终的判断权始终在人手中。

思辨时刻:AI 写出优美的诗歌,它拥有”灵感”吗?

大模型能写诗、编故事、甚至模仿特定作家的风格,这让许多人惊叹”AI 也有创造力了”。但回顾本节的内容就会发现:模型所做的一切,本质上都是基于概率的”文字接龙”——它选择的是”最可能的下一个词”,而非”最有灵魂的下一个词”。一首 AI 生成的诗之所以动人,是因为训练数据中无数人类诗人的才华被压缩成了统计规律。AI 不曾体验过月光下的孤独,却能写出”举头望明月”式的句子——这究竟是创造,还是精巧的重组?这个问题没有标准答案,但值得每一位使用者认真思考。

□ 术语卡片 > 词嵌入(Word Embedding):将文字转换为计算机能处理的数字向量的技术。语义相近的词在向量空间中距离更近,例如”国王”和”王后”的向量距离,小于”国王”和”苹果”的距离。

RLHF(基于人类反馈的强化学习):训练大模型的关键技术之一。人类标注员对模型的多个回答进行排序打分,模型据此学习”什么样的回答更好”,从而生成更符合人类期望的内容。

思维链(Chain of Thought, CoT):一种提示技巧,要求模型在给出最终答案前,先展示推理过程。类似于数学考试中的”写出解题步骤”,能显著提升模型在复杂推理任务上的表现。

MoE(混合专家模型):一种模型架构设计,将一个大模型拆分为多个”专家”子网络,每次只激活其中一部分来处理特定任务,从而在保持强大能力的同时降低计算成本。

1.4 主流 AI 工具全景图

了解了 AI 的原理之后,是时候认识那些可以立刻上手使用的工具了。本节将绘制一张当前主流 AI 工具的全景地图,帮助读者在面对具体任务时快速找到合适的工具。

一、四大类 AI 工具一览

当前面向普通用户的 AI 工具,大致可以分为文本对话、图像生成、音视频创作、办公协同四大类。为什么是这四类?因为它们分别对应了日常工作和学习中最常见的四种内容形态:文字、图片、音视频和文档。日常遇到的绝大多数任务,都可以归入其中一类。

1. 文本对话类

文本对话类工具是目前使用最广泛的 AI 应用。输入一段文字,它返回一段回答——这种交互方式简单直观,却能覆盖写作、翻译、编程、数据分析等大量场景。

表1-8 主流文本对话类AI工具对比

| 工具 | 开发方 | 特点 | 适用场景 |

|---|---|---|---|

| ChatGPT | OpenAI(美国) | 综合能力强,支持多模态,o 系列擅长深度推理 | 写作、翻译、编程、分析 |

| DeepSeek | 深度求索(中国) | 开源模型,支持深度思考与联网搜索 | 逻辑推理、代码生成、数据分析 |

| Gemini | Google(美国) | 3.1 Pro 多模态领先,Deep Think 模式擅长复杂推理 | 多语言、学术研究、编程 |

| Claude | Anthropic(美国) | Opus 4.6 编程与 Agent 能力业界领先 | 长文档分析、编程、学术写作 |

| Kimi | 月之暗面(中国) | 超长上下文(支持 200 万字) | 长文档阅读、论文分析 |

| 豆包 | 字节跳动(中国) | 集成文本、图像、视频生成的一站式平台 | 日常问答、内容创作 |

为什么有这么多工具? 每个工具背后是不同的大模型,它们在训练数据、模型架构和优化方向上各有侧重。就像不同品牌的汽车都能开,但有的省油、有的越野强、有的空间大——选择取决于具体需求。

2. 图像生成类

图像生成类工具能够根据文字描述生成图片,或对已有图片进行编辑。

表1-9 主流图像生成类AI工具对比

| 工具 | 特点 | 适用场景 |

|---|---|---|

| 即梦 AI | 字节跳动出品,中文友好,支持文字渲染 | 海报设计、商品图、社交媒体配图 |

| Midjourney | 艺术风格突出,画面质感强 | 概念设计、艺术创作、插画 |

| Stable Diffusion | 开源免费,可本地部署,高度可定制 | 批量生成、风格训练、技术研究 |

| DALL·E | OpenAI 出品,与 ChatGPT 深度集成 | 快速出图、创意构思 |

3. 音视频创作类

表1-10 主流音视频创作类AI工具对比

| 工具 | 能力 | 适用场景 |

|---|---|---|

| Suno | AI 音乐生成,Studio 支持多轨编辑 | 背景音乐、短视频配乐 |

| 剪映 AI | 智能剪辑、字幕生成、数字人 | 短视频制作、课程录制 |

| Seedance 2.0 | 字节跳动视频生成大模型,音画同步 | 文字/图片生成电影级视频 |

| HeyGen | 数字人视频生成,支持多语言 | 产品介绍、培训视频 |

| 通义听悟 | 语音转文字、会议纪要生成 | 会议记录、访谈整理 |

4. 办公协同类

表1-11 主流办公协同类AI工具对比

| 工具 | 能力 | 适用场景 |

|---|---|---|

| WPS AI | 文档写作、表格分析、PPT 生成 | 日常办公全流程 |

| AiPPT | 一键生成演示文稿 | 快速制作汇报 PPT |

| 通义听悟 | 音视频内容转文字摘要 | 会议纪要、课堂笔记 |

二、实操演示:同一任务,不同工具的表现对比

光看表格还不够直观。下面我们用一个真实任务来体验不同工具的差异。

任务:请用 200 字介绍”什么是碳中和”,面向高中生读者,语言通俗易懂。

第 1 步:打开 DeepSeek(https://chat.deepseek.com),输入上述提示词。

DeepSeek 的输出示例:

碳中和是指一个国家、企业或个人在一定时间内,通过植树造林、节能减排等方式,抵消自身产生的二氧化碳排放量,实现二氧化碳”净零排放”。打个比方:你每天呼吸、用电、开车都会产生碳排放,就像往一个水池里注水;而种树、使用清洁能源就像从水池里抽水。当注入和抽出的水量相等时,水池的水位不再上升——这就是”碳中和”。中国承诺在 2060 年前实现碳中和,这意味着我们需要在生产生活的方方面面减少碳排放,同时增加碳吸收能力。

第 2 步:打开 Kimi(https://kimi.moonshot.cn),输入同样的提示词。

Kimi 的输出示例:

想象地球穿着一件”碳外套”——大气中的二氧化碳越多,这件外套就越厚,地球就越热。碳中和的目标,就是让我们排出的碳和吸收的碳达到平衡,不再给地球”加衣服”。具体怎么做呢?一方面减少排放:少开燃油车、多用太阳能;另一方面增加吸收:多种树,因为树木能”吃掉”二氧化碳。当排放量等于吸收量,就实现了碳中和。我国计划在 2060 年前达成这个目标,这需要每个人从日常小事做起。

第 3 步:对比分析两者的输出。

表1-12 DeepSeek与Kimi输出风格对比

| 对比维度 | DeepSeek | Kimi |

|---|---|---|

| 比喻方式 | 水池注水/抽水 | 地球穿外套 |

| 信息密度 | 较高,包含具体政策目标 | 适中,侧重生活化表达 |

| 语言风格 | 偏科普,结构严谨 | 偏口语,亲切活泼 |

| 适合场景 | 课堂讲义、知识科普 | 社交媒体、轻松阅读 |

结论:两款工具都能完成任务,但风格各有特色。DeepSeek 的回答更适合正式场景,Kimi 的回答更适合轻松传播。在实际使用中,可以根据目标受众和使用场景来选择工具,甚至将两者的优点结合起来。

三、工具选用三原则

面对琳琅满目的 AI 工具,如何做出选择?建议遵循以下三个原则:

原则一:场景匹配

不同工具有不同的擅长领域。写文章用 DeepSeek,画海报用即梦 AI,做视频用剪映——选择工具的第一标准是”它是否擅长要做的事”,而非”它是否最有名”。

下面是一张快速选择参考表:

表1-13 AI工具选用快速参考

| 任务需求 | 推荐工具 | 理由 |

|---|---|---|

| 写一篇课程论文 | DeepSeek / ChatGPT / Claude | 逻辑推理和长文本生成能力强 |

| 阅读一份 50 页的 PDF 报告 | Kimi / Claude | 超长上下文窗口,能一次读完整份文档 |

| 设计一张活动海报 | 即梦 AI / DALL·E | 中文渲染效果好,操作简单 |

| 制作一段产品介绍视频 | HeyGen / 剪映 AI | 数字人+字幕自动生成 |

| 用文字生成电影级短视频 | Seedance 2.0(豆包) | 音画同步,物理规律还原 |

| 整理一场会议的录音 | 通义听悟 | 语音转文字准确率高 |

原则二:数据安全——你的隐私,你做主

当你在深夜向 AI 倾诉烦恼、上传简历求职建议、或者让它分析你的消费记录时,有没有想过:这些信息去了哪里?使用 AI 工具时,输入的内容可能被用于模型训练,这意味着你的个人信息有可能以某种形式”留在”了云端。因此: 不要向公共 AI 工具输入个人隐私信息(身份证号、银行卡号等);

不要上传涉及商业机密或未公开数据的文件;

涉及敏感信息时,优先选择支持本地部署的工具(如 Stable Diffusion)或明确承诺不使用用户数据训练的服务。

保护个人数据不仅是一项技术操作,更是数字时代公民的基本素养。正如我们不会把身份证随意交给陌生人,也不应该毫无防备地将个人信息交给 AI。

原则三:成本可控

大多数 AI 工具提供免费额度,但高级功能通常需要付费。在选择工具时,应评估: 免费额度是否满足日常需求?

付费方案的性价比如何?

是否有开源替代方案?

实用建议:先用免费版本充分体验,确认某款工具确实能显著提升效率后,再考虑付费。不要因为”别人都在用”就盲目订阅。

四、常见问题

Q1:AI 工具更新很快,我学的内容会不会很快过时?

工具的界面和功能确实会频繁更新,但本书教授的是使用 AI 的方法论——如何提问、如何评估输出、如何选择工具。这些底层能力不会因为某个按钮换了位置而失效。

Q2:国产工具和国外工具,应该选哪个?

对于中文场景,国产工具(DeepSeek、Kimi、豆包等)通常表现更好,且访问更稳定。对于英文场景或需要最前沿能力的任务,ChatGPT、Claude、Gemini 等国外工具可能更有优势。建议两类工具都熟悉,根据具体任务灵活切换。

Q3:免费工具和付费工具差距大吗?

对于日常学习和轻度使用,免费版本已经足够。付费版本的优势主要体现在:更快的响应速度、更长的上下文窗口、更高级的功能(如图片生成、文件分析等)。可以先用免费版,遇到瓶颈时再考虑升级。

思辨时刻:不是所有问题都需要 AI

有学者讲述了一个发人深省的故事 [2]:一家名为”Slice Intelligence”的公司开发了一个 AI 系统来预测披萨的销量。系统非常复杂,使用了大量数据和先进算法。但最终,一位经验丰富的披萨店老板仅凭”周五晚上订单多、下雨天外卖多”这样的常识,就做出了同样准确的预测。

这个故事提醒我们:在使用 AI 之前,先问自己一个问题——这个任务真的需要 AI 吗? 有时候,一个简单的 Excel 公式、一次搜索引擎查询,甚至一个电话,就能解决问题。AI 是工具箱里的一把锤子,但不是所有问题都是钉子。

本节小结

本节绘制了一张 AI 工具的全景地图,涵盖文本、图像、音视频和办公四大类。通过同一任务在不同工具上的对比演示,可以直观感受到工具之间的差异。选择工具时,请牢记三个原则:场景匹配、数据安全、成本可控。

更重要的是,保持一种清醒的态度:AI 工具是为人服务的,而不是反过来。 不要为了”用 AI”而用 AI,而是在真正需要时,选择最合适的工具来提升效率。

在后续章节中,我们将逐一深入这些工具的实际操作。但在此之前,下一章将先解决一个关键问题:如何与 AI 高效对话? 这就是提示词工程的艺术。

本章小结

本章围绕”认识人工智能”这一核心主题,从历史演进、概念辨析、技术原理和工具全景四个维度,帮助读者建立关于 AI 的系统性认知框架。理解 AI 的本质与边界,是后续高效使用 AI 工具的基础。

| 小节 | 核心内容 | 关键概念 |

|---|---|---|

| 1.1 AI 的三次浪潮 | 回顾人工智能从符号主义、专家系统到深度学习的七十年发展历程,揭示技术演进的周期性规律 | 符号主义、专家系统、深度学习 |

| 1.2 机器学习、深度学习与生成式 AI | 厘清四个核心概念的层层嵌套关系,建立从”人工智能”到”生成式 AI”的清晰技术地图 | 机器学习、深度学习、生成式 AI |

| 1.3 大模型是怎么”思考”的 | 用通俗比喻解构大语言模型的工作原理,揭示 AI 幻觉产生的根本原因 | Token 预测、Transformer、RAG、AI 幻觉 |

| 1.4 主流 AI 工具全景图 | 梳理文本、图像、音视频、办公四大类 AI 工具,提出场景匹配、数据安全、成本可控三项选用原则 | 工具选型、数据安全、场景匹配 |

AI 是强大的工具而非智慧本身,建立准确的技术直觉是驾驭 AI 的第一步。下一章将解决一个关键问题:如何与 AI 高效对话——这便是提示词工程的艺术。

第一章 实践与练习

纸上得来终觉浅,绝知此事要躬行。本章的练习就是帮你从”知道”走向”做到”。

一、选择题

- 人工智能学科的诞生标志是哪一事件?

- A. 图灵发表《计算机器与智能》

- B. 1956 年达特茅斯会议

- C. AlphaGo 战胜李世石

- D. ChatGPT 发布

- 以下哪项技术属于第二次 AI 浪潮的代表?

- A. 深度学习

- B. 专家系统

- C. 生成式 AI

- D. Transformer 架构

- 大语言模型生成文本的核心机制是:

- A. 从数据库中检索现成答案

- B. 预测下一个最可能的 Token

- C. 将用户问题翻译为程序代码执行

- D. 调用搜索引擎获取实时信息

- RAG 技术的核心价值在于:

- A. 让模型运行速度更快

- B. 让模型不需要训练数据

- C. 让模型能基于外部知识库生成更准确的回答

- D. 让模型具备情感理解能力

- 以下关于 AI 幻觉的说法,正确的是:

- A. 只有免费模型才会产生幻觉

- B. 幻觉是模型故意欺骗用户

- C. 幻觉源于模型基于概率生成文本的机制

- D. 使用付费版本可以完全避免幻觉

二、简答题

请用自己的话解释”机器学习”和”深度学习”的区别,并各举一个应用场景。

为什么说第三次 AI 浪潮”这次不一样”?请从算力、数据、算法三个角度简要说明。

什么是 AI 幻觉?在使用 AI 工具时应该如何应对?

三、实操题

工具对比实验:分别使用 DeepSeek 和 Kimi,向它们提出同一个问题:“请用 300 字介绍你所在城市的一个著名景点”。对比两者的回答,从信息准确性、语言风格、细节丰富度三个维度进行分析,并将分析结果整理为表格。

AI 幻觉检测:向任意一款 AI 工具提问:“请介绍诺贝尔数学奖的历届获奖者。”观察 AI 的回答,判断其中是否存在幻觉(提示:诺贝尔奖并没有数学奖),并记录发现。

概念梳理:使用 DeepSeek,输入提示词”请用一张表格对比人工智能、机器学习、深度学习、生成式 AI 四个概念的定义、核心技术和典型应用”。检查 AI 的输出是否准确,如有错误请指出并修正。

参考答案(选择题):1-B 2-B 3-B 4-C 5-C

四、进阶挑战

题目:我的”数字分身”计划

背景:假设你是一名大学生,想利用 AI 工具来辅助你的学习和生活。

要求:请根据本章学到的”AI 工具全景图”,设计一套属于你的 AI 组合拳方案。你需要列出:

- 场景:你会用 AI 做什么?(至少 3 个场景,如:写论文综述、做社团海报、练英语口语)

- 工具:每个场景选择什么工具?为什么选它?

- 原则:在使用过程中,你会如何规避风险(如查重、隐私)?

提交格式示例:

场景 1:英语口语练习

工具:ChatGPT (语音模式)

理由:它的语音识别准确,且发音自然,能进行多轮对话。

避坑:不跟它聊涉及个人身份证号的话题。

五、思辨与讨论

以下问题没有标准答案,用来引发深入思考和课堂讨论。

- 如果一个 AI 能流畅地和你聊天、安慰你的情绪、记住你的喜好,它算是你的”朋友”吗?“友谊”是否必须建立在双方都有意识的基础上?

- AI 能写诗、画画、作曲,但它从未体验过悲伤或喜悦。没有生命体验的”创作”,能算真正的艺术吗?

- 回顾 1.1 节的”中文屋”实验:当 AI 的回答与人类专家无法区分时,我们还有必要追问它是否”真正理解”吗?“理解”的标准应该由谁来定义?

六、延伸阅读

- 视频:[3Blue1Brown] 神经网络是如何学习的?(Bilibili 可搜)

- 书籍:《人机共生:智能时代的生存策略》 [9]