第八章 AI 的局限与风险——清醒地使用工具

本章摘要: AI 很强,但也很危险。它会一本正经地胡说八道(幻觉),会歧视某些群体(偏见),甚至会泄露你的隐私(安全)。作为一个成熟的 AI 使用者,不能只看到它的光环,更要看到它的阴影。本章将帮助读者建立一道”防火墙”,在享受便利的同时,不被算法算计。

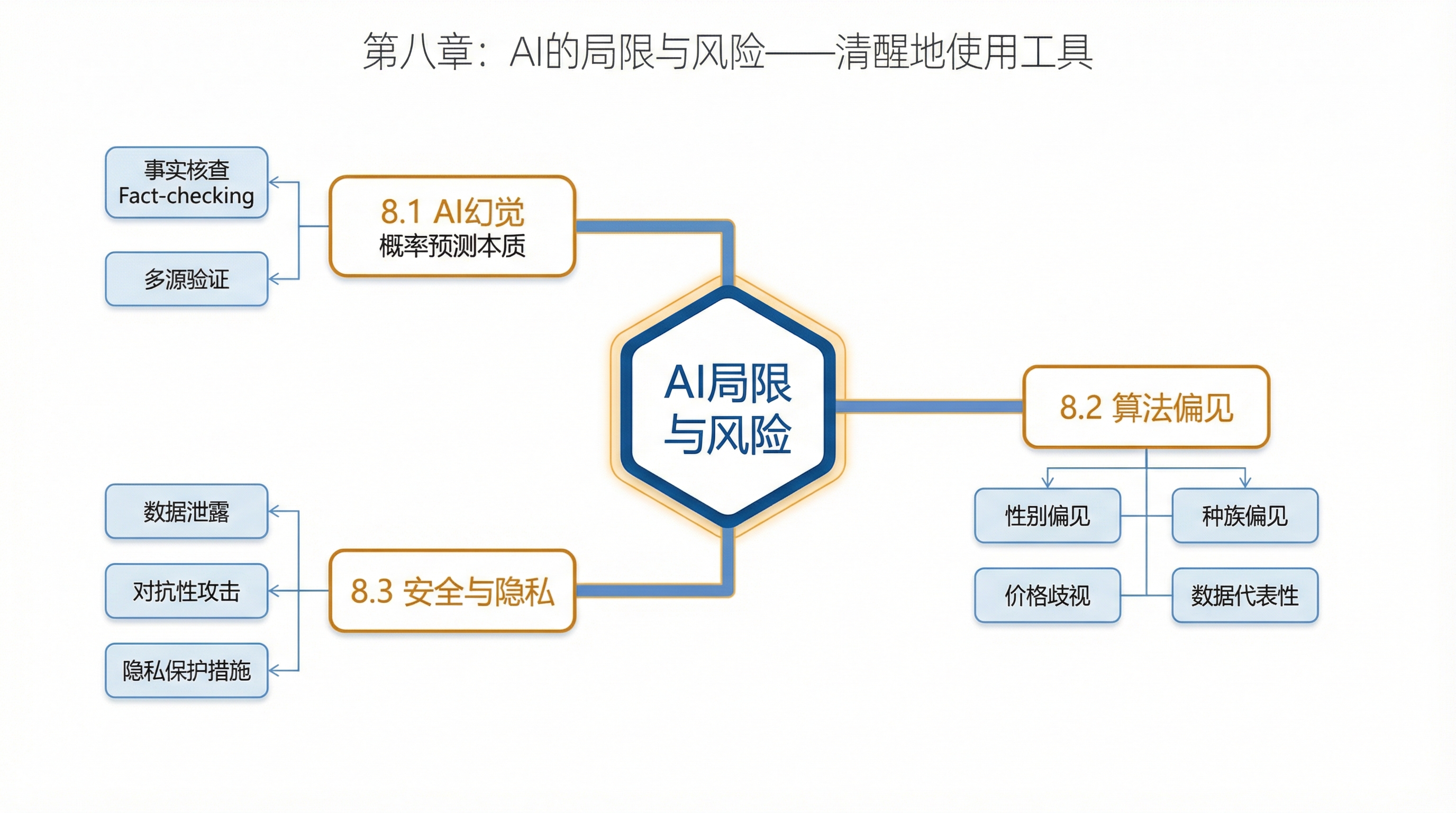

知识图谱

导言:当 AI 判断失误

前面七章中,我们学习了 AI 在文字、图像、音视频、数据分析和智能体搭建等领域的强大能力。但正如任何工具都有其局限性,AI 也有它”不擅长”甚至”会犯错”的地方。

如果医生完全听信 AI 的诊断,可能会开错药;如果法官完全听信 AI 的量刑建议,可能会冤枉好人;如果你完全听信 AI 写的论文,可能会因为引用了不存在的文献而被判定学术不端。

清醒地认识这些局限和风险,不是为了否定 AI 的价值,而是为了学会“带着怀疑去信任”,更安全、更负责任地使用它。当机器开始模仿人类思考时,人类最珍贵的能力不再是”不出错”,而是”能够判断什么是错”——这种判断力,正是本章要培养的核心素养。

学习目标

完成本章学习后,读者将能够:

- 解释 AI 幻觉产生的根本原因(概率预测),并掌握事实核查(Fact-checking)的方法;

- 识别 算法偏见(如性别、种族、价格歧视)的常见形式,理解其社会危害;

- 应用 数据安全保护措施,避免在使用 AI 工具时泄露个人隐私;

- 辨析 “对抗性攻击”(Adversarial Attack)对 AI 系统的潜在威胁。

8.1 AI 幻觉:一本正经的胡说八道

向 AI 提一个问题,它流畅自信地给出了答案——但答案是错的。这就是”AI 幻觉”。

一、什么是 AI 幻觉?

AI 幻觉(Hallucination)是指大语言模型生成的内容看起来合理、表述流畅,但实际上包含事实性错误、虚构信息或不存在的引用。这一术语借用了心理学中”幻觉”的概念——患者感知到并不存在的事物,且对此深信不疑。AI 的”幻觉”与之类似:模型”感知”到了训练数据中并不存在的事实关联,却以极高的置信度将其呈现出来。

这是 AI 最危险的特性之一——因为它”犯错”的方式和人类截然不同。人类不确定时会犹豫、会说”我不太确定”,但 AI 不会。它会用同样自信的语气说出正确的事实和编造的谎言,令人很难分辨。研究表明,即使是最先进的大语言模型,在事实性问答任务中的幻觉率仍在 3%—15% 之间波动,而在专业领域(如医学、法律)中,这一比例可能更高。

典型表现:

表8-1 AI幻觉的常见类型与示例

| 类型 | 示例 |

|---|---|

| 虚构事实 | 编造不存在的历史事件或人物 |

| 伪造引用 | 给出看似真实但实际不存在的论文标题和作者 |

| 张冠李戴 | 将 A 的成就归到 B 身上 |

| 过度自信 | 对不确定的信息给出确定性的表述 |

二、为什么会产生幻觉?

回顾 1.3 节的内容:大语言模型的本质是基于概率的下一个词预测。它并不”理解”事实,而是根据训练数据中的统计规律,生成”最可能”的下一个词。

这意味着: 当训练数据中某个错误信息出现频率较高时,模型可能会”学会”这个错误;

当模型遇到训练数据中未覆盖的问题时,它不会说”我不知道”,而是会”编造”一个看起来合理的答案;

模型追求的是”语言流畅性”,而非”事实准确性”——它的优化目标是让输出”读起来像对的”,而不是”确保是对的”。

用 1.3 节的比喻来说,AI 是一只”自信的鹦鹉”——它能说出非常流利的话,但并不真正理解自己在说什么。理解这一底层机制,有助于在使用 AI 时保持恰当的警觉。AI 的自信程度与其准确程度之间,并不存在必然的对应关系。

思辨时刻:当”大概率正确”取代了”确定正确”

人类知识体系建立在”可证伪性”之上——一个命题之所以可信,是因为它经受住了反复检验。而 AI 的”知识”建立在统计概率之上——一个回答之所以被输出,是因为它在训练数据中出现的频率最高。这两种”正确”有本质区别:前者追问”为什么对”,后者只关心”像不像对”。当越来越多的人习惯于接受 AI 的”大概率正确”而放弃自己的求证过程时,人类对知识的确定性标准是否正在悄然降低?

三、RAG 如何缓解幻觉

既然幻觉源于模型的”闭卷作答”,那么一个直觉性的解决思路就是:让它”开卷考试”。RAG(Retrieval-Augmented Generation,检索增强生成)正是基于这一思路的技术方案(详见 1.3 节)。

用户提问 → 从知识库中检索相关文档 → 将文档作为参考提供给模型 → 模型基于文档生成回答RAG 的核心思路是:让模型”开卷考试”,而非”闭卷作答”。当模型的回答有据可查时,幻觉的概率会大幅降低。

第七章中我们在扣子平台搭建的知识库,本质上就是 RAG 的实践应用。

四、信息核查实用方法

即使使用了 RAG,AI 的输出仍然需要人工核查。以下是三种实用的核查方法:

1. 多源验证

对于 AI 给出的关键事实,至少用两个独立信息源进行交叉验证。

AI 说:"中国第一条高铁于 2008 年 8 月 1 日开通。"

→ 验证方式:搜索引擎查询 + 官方新闻报道2. 溯源查证

要求 AI 给出信息来源,然后去核实来源是否真实存在。

提示词:"请给出你引用的数据来源,包括作者、标题和发表时间。"

→ 然后去学术数据库或搜索引擎验证这些来源是否存在3. 逻辑检验

检查 AI 的回答是否存在逻辑矛盾或常识性错误。

AI 说:"该公司 2023 年营收 100 亿元,同比增长 50%,

2022 年营收为 80 亿元。"

→ 逻辑检验:80 亿 × 1.5 = 120 亿,而非 100 亿,数据自相矛盾职场生存核查法:在实际工作中,以上三种方法可以简化为一个快速流程——“30 秒核查法”:①AI 给出的关键数字,立刻搜索验证;②AI 引用的文献或法规,立刻查原文;③AI 的结论如果将影响决策,至少找一位该领域的人确认。养成这个习惯,就能在享受 AI 效率的同时,避免”把 AI 的幻觉写进工作报告”的尴尬。

五、不同领域的幻觉风险

AI 幻觉在不同领域的危害程度不同。以下是几个高风险领域的典型案例:

表8-2 AI幻觉在不同领域的风险

| 领域 | 幻觉示例 | 潜在危害 |

|---|---|---|

| 医疗健康 | AI 编造不存在的药物名称或错误的用药剂量 | 可能危及生命安全 |

| 法律咨询 | AI 引用不存在的法律条文或判例 | 可能导致错误的法律决策 |

| 学术研究 | AI 伪造论文标题、作者和期刊名称 | 可能导致学术不端 |

| 财务分析 | AI 编造公司财务数据或市场统计 | 可能导致错误的投资决策 |

离你更近的风险:上表中的案例看似遥远,但 AI 幻觉的威胁就在日常学习和工作中。幼儿教育专业的学生如果用 AI 生成的”儿童发展里程碑”数据来设计教案,错误的月龄指标可能误导教学判断;艺术设计专业的学生如果让 AI 介绍某位艺术家的生平,张冠李戴的作品归属会暴露专业素养的缺失;财会专业的学生如果直接引用 AI 给出的税率或会计准则条文,一个小数点的错误就可能在实务中造成严重后果。在自己的专业领域,你就是 AI 输出的最后一道质检关。

真实案例:AI 生成虚假图像引发的社会影响

近年来,每当重大自然灾害发生后,社交媒体上都会出现大量 AI 生成的虚假”现场照片”。这些图片画面极具冲击力,被大量转发。但细心的网友往往能发现破绽:图片中人物手指数量异常(出现六根手指)、建筑透视关系不合理、文字扭曲变形——这些都是当前 AI 生成图像的典型特征。虚假图片的传播不仅误导了公众对灾情的判断,还挤占了真实救援信息的传播空间。

另一个常见的场景是 AI 换脸广告诈骗。不法分子利用 AI 技术将公众人物的面部”嫁接”到虚假广告视频中,伪造名人代言,诱导消费者购买假冒产品或参与投资骗局。受害者往往因为”亲眼看到了视频”而放松了警惕。

实操演示:亲手”抓住” AI 的幻觉

第 1 步:向 DeepSeek 提问:“请推荐 3 篇关于大学生 AI 素养教育的中文学术论文,给出作者、标题、期刊和年份。”

第 2 步:将 AI 给出的论文信息逐一到中国知网(cnki.net)或百度学术中搜索验证。

第 3 步:记录验证结果。很可能会发现:部分论文标题看起来很真实,但在数据库中根本找不到——这就是典型的”伪造引用”型幻觉。

核心教训:AI 越是在使用者不熟悉的领域给出”专业”回答,越需要警惕。因为缺乏判断力的地方,恰恰是幻觉最容易蒙混过关的地方。

思政融入:学术诚信与职业操守。AI 伪造引用的现象,对学术诚信提出了新的挑战。如果不加验证地将 AI 生成的”参考文献”写入论文或报告,本质上是一种学术不端行为——即便出错的是机器,署名者才是责任人。“大胆假设、小心求证”的科学精神在 AI 时代不仅没有过时,反而更加重要。无论未来从事什么职业,对自己产出内容的真实性负责,是最基本的职业操守。

主线任务:AI 幻觉侦探

- 向 DeepSeek 提出以下问题:“请介绍鲁迅先生的小说《狂人日记》中的主要人物和情节。”

- 仔细阅读 AI 的回答,对照原著或权威资料,找出其中的事实性错误;

- 再尝试 2—3 个自己熟悉领域的专业问题,记录 AI 的错误类型和频率;

- 总结:在哪些类型的问题上,AI 更容易产生幻觉?

8.2 算法偏见:谁的 AI?

AI 不会”歧视”,但训练它的数据和设计它的人可能会。

一、什么是算法偏见?

算法偏见(Algorithmic Bias)是指 AI 系统在决策过程中,对某些群体产生系统性的不公平对待。这种偏见通常不是开发者有意为之,而是隐藏在训练数据和模型设计的各个环节中。

可能会想:AI 是数学和代码构成的,怎么会有”偏见”?关键在于——AI 从数据中学习,而数据来自人类社会。如果社会中存在偏见,数据就会携带偏见,AI 就会”学会”偏见。更危险的是,AI 的偏见被包装在”客观算法”的外衣下,比人类的偏见更难被察觉和质疑。哈佛大学法学院教授凯斯·桑斯坦(Cass Sunstein)将这种现象称为”算法的权威幻觉”——人们倾向于认为机器的判断比人类更公正,从而放松了对其输出结果的审视。

二、五个经典案例

以下案例涵盖了招聘、执法、公共服务、消费和司法等不同领域,展示了算法偏见的普遍性和多样性。

案例一:亚马逊招聘 AI 歧视女性

2018 年,亚马逊被曝其内部使用的 AI 招聘系统对女性候选人存在系统性歧视。该系统在筛选简历时,会自动降低包含”女性”相关词汇(如”女子大学”“女子棋社”)的简历评分。

原因分析:该系统的训练数据来自亚马逊过去 10 年的招聘记录。由于科技行业历史上以男性员工为主,AI 从数据中”学到”了一个错误的规律——男性候选人更”优秀”。

案例二:面部识别的肤色偏差

MIT 研究员 Joy Buolamwini 的研究发现,主流面部识别系统对深色肤色人群的错误率高达 34.7%,而对浅色肤色人群的错误率仅为 0.8%。

原因分析:训练数据中深色肤色的面部图片严重不足,导致模型对这一群体的识别能力远低于其他群体。

案例三:波士顿修路 App 的数据偏差

波士顿市政府开发了一款 App,市民可以通过手机报告路面坑洞,政府据此安排修路优先级。结果发现,富裕社区的道路修复速度远快于低收入社区。

原因分析:富裕社区的居民智能手机普及率更高、使用 App 的意愿更强,因此报告的坑洞数量更多。AI 系统将”报告数量多”等同于”问题更严重”,导致资源分配向富裕社区倾斜。

案例四:“大数据杀熟”

同一款商品或服务,老用户看到的价格比新用户更高;使用高端手机的用户看到的价格比普通手机用户更高。这种现象被称为”大数据杀熟”,本质上是算法基于用户画像进行的价格歧视。

案例五:COMPAS 司法评估系统的种族偏见

美国多个州使用的 COMPAS(Correctional Offender Management Profiling for Alternative Sanctions)系统,用于评估犯罪嫌疑人的再犯风险,辅助法官做出保释和量刑决定。调查发现,该系统对非裔美国人的再犯风险评估显著偏高——在实际未再犯的人群中,非裔被错误标记为”高风险”的比例是白人的近两倍。

原因分析:系统的训练数据来自历史司法记录,而美国司法系统长期存在对少数族裔的不平等执法,这些历史偏见被 AI “学习”并放大了。

三、实操演示:亲手检测 AI 的框架效应偏见

框架效应(Framing Effect)是指同一个问题,因为表述方式不同,会导致截然不同的回答。AI 同样存在这种偏见——提问的措辞会显著影响输出的立场和倾向。

第 1 步:向 DeepSeek 提问:“请客观分析核能发电的安全性。”记录 AI 的回答,注意其整体态度是偏正面还是偏负面。

第 2 步:换一种措辞再问:“请客观分析核能发电的危险性。”同样记录回答的态度倾向。

第 3 步:对比两次回答。很可能会发现:

当提问中使用”安全性”时,AI 倾向于列举安全保障措施、技术进步和低事故率;当使用”危险性”时,AI 倾向于强调核泄漏风险、放射性废料处理难题和历史事故。两次回答引用的数据和案例可能完全不同,尽管讨论的是同一个话题。

以下是实际测试中观察到的典型输出对比:

提问”安全性”时的典型 AI 输出示例:

核能发电在安全性方面已取得显著进步。现代核电站配备多重冗余安全系统,第三代核电技术(如 AP1000)采用非能动安全设计,即使在断电情况下也能自动冷却堆芯。根据国际原子能机构数据,核能每千瓦时的死亡率(0.07 人/TWh)远低于煤电(24.6 人/TWh)。目前全球约 10% 的电力来自核能,运行记录总体安全可靠。

提问”危险性”时的典型 AI 输出示例:

核能发电存在不可忽视的安全隐患。切尔诺贝利(1986 年)和福岛(2011 年)事故表明,核事故一旦发生,放射性污染可持续数十年。高放射性核废料的安全处置至今没有公认的最终解决方案,需要隔离储存数千年。此外,核电站遭受恐怖袭击或极端天气的潜在风险也不容忽视。

对比两次回答可以发现,两者引用的数据和案例几乎完全不同,各自强调的面向截然相反,但都以”客观分析”的口吻呈现。这正是框架效应偏见的典型表现——提问方式预设了立场,AI 的回答则强化并放大了这一预设。

第 4 步:继续测试更多话题——“短视频对青少年的益处”vs”短视频对青少年的危害”、“人工智能的发展前景”vs”人工智能的潜在威胁”。记录每组回答的态度差异。

结果分析:AI 并非在”客观分析”,而是在迎合提问者的预设立场。这种框架效应偏见意味着:如果你带着倾向性去提问,AI 会强化你已有的观点,而非提供平衡的视角。这在心理学中被称为”确认偏误的放大器”。

核心教训:使用 AI 辅助决策或写作时,要有意识地从正反两面提问,综合多次回答后再形成判断。单次提问得到的”客观分析”,往往并不客观。

更深一层的警觉:当你不加审视地使用 AI 生成的带有偏见的内容——比如用它写的分析报告发布出去、用它生成的论点写进文章里——你就从偏见的”旁观者”变成了偏见的”传播者”。AI 的偏见只有通过人的手才能进入现实世界,而那双手可能就是你的。

四、偏见从哪里来?

上述案例看似各不相同,但背后的偏见来源可以归纳为四种类型:

表8-3 算法偏见的四种来源

| 偏见来源 | 说明 | 对应案例 |

|---|---|---|

| 数据偏差 | 训练数据不能代表全部群体 | 面部识别、亚马逊招聘 |

| 样本偏差 | 数据收集方式导致某些群体被遗漏 | 波士顿修路 App |

| 标签偏差 | 人工标注数据时带入主观偏见 | 内容审核系统 |

| 设计偏差 | 系统设计者的价值观影响算法逻辑 | 大数据杀熟 |

翻车现场:2024 年,Google 的 AI 图像生成工具 Gemini 在用户要求生成”美国开国元勋”的图片时,生成了包含多种肤色的人物形象——其中包括深色肤色的乔治·华盛顿。这一”过度纠偏”引发了巨大争议:为了避免种族偏见,AI 反而扭曲了历史事实。Google 不得不紧急下线该功能。这个案例说明,消除偏见并非简单地”反向补偿”,而是需要在事实准确性与公平性之间找到平衡——矫枉过正本身也是一种偏见。

思辨时刻:如何识别和对抗算法偏见?

算法偏见的危险之处在于它的”隐蔽性”——它藏在代码和数据中,不像人类的偏见那样容易被察觉和质疑。

思考以下问题: 1. 假设一名教师使用 AI 系统为学生推荐学习资源,应如何检查系统是否存在偏见? 2. “AI 只是反映了社会中已有的偏见”——这个说法能否成为 AI 偏见的免责理由? 3. 在日常生活中是否遇到过疑似”算法偏见”的情况?(如搜索结果、推荐内容、价格差异)

8.3 数据安全与隐私保护

使用 AI 的同时,AI 也在”使用”用户的数据。

一、为什么数据安全与每个人有关

有人可能觉得”数据安全”是企业和程序员才需要关心的事。但事实上,每一次与 AI 对话,用户都在向远程服务器发送数据。这些数据可能包括个人信息、学习内容、工作文件,甚至是思维方式和行为习惯。据统计,一个活跃的 AI 工具用户每月平均产生数万条对话记录,这些记录中往往无意间包含了大量可识别个人身份的信息。

2023 年,三星电子的工程师将公司内部的半导体源代码粘贴到 ChatGPT 中寻求帮助,导致商业机密泄露。这一事件促使三星全面禁止员工使用外部 AI 工具。类似的事件并非个例——意大利曾因数据隐私问题一度禁止 ChatGPT,多家企业也制定了严格的 AI 使用规范。

另一个值得警惕的案例:2023 年,国内发生了一起利用 AI 换脸技术实施的电信诈骗案。犯罪分子通过 AI 实时换脸和变声技术,在视频通话中伪装成受害人的朋友,仅用 10 分钟就骗走了 430 万元。受害人全程以为自己在和真人朋友视频聊天,完全没有察觉异常。

这些案例说明:数据一旦发送给 AI 平台,用户就失去了对它的完全控制。 更深层的问题是:当 AI 可以完美复制你的脸、你的声音、你的写作风格时,“我是我”这件事还能靠什么来证明?数字身份的可伪造性,正在动摇人际信任的基础——未来,“眼见为实”可能不再成立。因此,学会保护自己的数据,是 AI 时代的必备素养。

二、个人数据如何被收集和使用

使用 AI 工具时,以下数据可能被收集:

表8-4 AI工具可能收集的用户数据类型

| 数据类型 | 示例 | 潜在风险 |

|---|---|---|

| 对话内容 | 用户与 AI 的所有对话记录 | 可能被用于模型训练,泄露个人信息 |

| 上传文件 | 文档、图片、音频 | 文件内容可能被存储在云端服务器 |

| 使用行为 | 使用时间、频率、功能偏好 | 用于构建用户画像 |

| 设备信息 | IP 地址、设备型号、操作系统 | 用于定位和身份关联 |

关键提醒:不要在 AI 对话中输入以下敏感信息: 身份证号、银行卡号、密码;公司商业机密或未公开的项目信息;他人的隐私信息(未经授权)。

三、对抗性攻击:微小扰动如何欺骗 AI

除了数据泄露风险,AI 系统本身的安全性也值得关注。对抗性攻击(Adversarial Attack)是指通过对输入数据进行微小的、人眼几乎不可察觉的修改,使 AI 模型产生错误判断。这一概念由 Goodfellow 等研究者于 2014 年首次系统提出,此后成为 AI 安全领域的核心研究方向之一。

经典案例:研究人员在一张熊猫图片上添加了极其微小的噪声扰动(人眼完全看不出区别),AI 图像识别系统就将其错误识别为”长臂猿”,且置信度高达 99%。

这意味着什么?

自动驾驶系统可能因路标上的微小贴纸而误判交通标志;

人脸识别系统可能被特制的眼镜或化妆所欺骗;

内容审核系统可能被精心设计的文字变体所绕过。

对抗性攻击揭示了一个重要事实:AI 的”看”和人类的”看”有本质区别——AI 依赖像素级的数学特征,而非真正的”理解”。

四、使用 AI 工具时的安全准则

表8-5 使用AI工具的数据安全准则

| 准则 | 具体做法 |

|---|---|

| 最小信息原则 | 只提供完成任务所必需的信息,不多给 |

| 脱敏处理 | 上传数据前,将姓名、电话等替换为化名 |

| 阅读隐私政策 | 了解工具如何存储和使用用户的数据 |

| 定期清理 | 删除不再需要的对话记录和上传文件 |

| 选择可信平台 | 优先使用有明确数据保护承诺的工具 |

五、法律框架:GDPR 与《个人信息保护法》

表8-6 主要个人信息保护法规对比

| 法规 | 适用范围 | 核心要求 |

|---|---|---|

| GDPR(欧盟) | 处理欧盟居民个人数据的所有组织 | 数据最小化、目的限制、用户知情同意、被遗忘权 |

| 《个人信息保护法》(中国) | 处理中国境内个人信息的所有组织 | 合法正当必要原则、知情同意、最小必要、安全保障 |

与每位用户相关的权利: 知情权:用户有权知道哪些数据被收集、如何被使用;

同意权:收集个人数据前应征得本人同意;

删除权:用户有权要求删除个人数据;

更正权:用户有权要求更正不准确的个人数据。

这些权利不是摆设:当你发现某个 App 在未经同意的情况下收集了你的位置信息,你可以依据《个人信息保护法》向平台投诉并要求删除;当你在某个 AI 平台上传了文件后想撤回,你有权要求平台删除已存储的数据。大多数正规平台都在”设置—隐私”中提供了数据导出和删除的入口。知道自己有什么权利,是行使权利的第一步。

六、实操演示:数据脱敏实战

在向 AI 提交数据之前,应先对敏感信息进行脱敏处理。以下是一个完整的练习。

第 1 步:假设需要让 AI 帮忙分析以下学生信息表,找出成绩异常的学生:

姓名:张三,学号:2024010001,手机:13812345678,成绩:92

姓名:李四,学号:2024010002,手机:13987654321,成绩:15

姓名:王五,学号:2024010003,手机:13611112222,成绩:88第 2 步:在发送给 AI 之前,将敏感信息替换为化名:

姓名:学生A,学号:***,手机:***,成绩:92

姓名:学生B,学号:***,手机:***,成绩:15

姓名:学生C,学号:***,手机:***,成绩:88第 3 步:向 DeepSeek 提问:“以下是三位学生的成绩数据,请帮我分析是否有异常值:学生A 92分,学生B 15分,学生C 88分。”

AI 回答示例:

学生B 的成绩(15分)明显偏低,属于异常值。建议: 1. 确认是否为录入错误(如实际成绩为 51 分,数字颠倒); 2. 如成绩属实,建议与该学生沟通了解原因; 3. 其余两位学生成绩在正常范围内。

关键原则:AI 只需要与任务相关的信息。分析成绩不需要姓名、学号和手机号,因此这些信息完全不必提供。

阅读材料:自动驾驶的”电车难题”——代码能预设道德抉择吗?

经典的”电车难题”在自动驾驶时代有了新的版本:一辆自动驾驶汽车即将发生不可避免的碰撞,它只能选择撞向左边的一位老人,或者右边的两个孩子。这个决定应该由谁来做?程序员?车主?还是 AI 自己?

MIT 的”道德机器”(Moral Machine)实验收集了全球数百万人的选择数据,发现不同文化背景的人有着截然不同的道德偏好。这意味着,即使我们想把道德规则写进代码,也无法找到一个”全球通用”的标准。

这个案例提醒我们:有些决策不应该交给 AI,因为它们涉及的不是技术问题,而是价值观问题。

本章小结

本章从 AI 幻觉、算法偏见和数据安全三个维度,系统剖析了 AI 技术的局限与风险。清醒地认识这些问题,不是为了否定 AI 的价值,而是为了学会”带着怀疑去信任”,培养判断力这一 AI 时代最珍贵的素养。

| 小节 | 核心内容 | 关键概念 |

|---|---|---|

| 8.1 AI 幻觉 | 解析 AI 生成虚假信息的根本原因(概率预测),掌握多源验证和事实核查的方法 | AI 幻觉、事实核查、概率预测 |

| 8.2 算法偏见 | 识别 AI 系统中性别、种族、价格歧视等常见偏见形式,理解其社会危害 | 算法偏见、数据偏见、公平性 |

| 8.3 数据安全与隐私保护 | 掌握使用 AI 工具时的隐私保护措施,理解对抗性攻击对 AI 系统的威胁 | 数据安全、隐私保护、对抗性攻击 |

当机器开始模仿人类思考时,人类最珍贵的能力不再是”不出错”,而是”能够判断什么是错”。下一章将从技术视角转向制度与人的视角,探讨 AI 的法律边界、伦理治理与职业未来。

第八章 实践与练习

知道风险,是为了更好地控制风险。

一、选择题

- AI 幻觉的本质原因是:

- A. AI 故意编造信息来欺骗用户

- B. AI 基于概率预测生成文本,而非真正理解事实

- C. AI 的计算能力不足

- D. 用户的提问方式不正确

- 以下哪种方法不属于信息核查的有效手段?

- A. 多源验证:用多个独立信息源交叉验证

- B. 溯源查证:核实 AI 给出的引用来源是否真实存在

- C. 直接信任:AI 回答流畅自信,说明信息准确

- D. 逻辑检验:检查回答中是否存在数据矛盾

- 亚马逊招聘 AI 歧视女性的根本原因是:

- A. 开发者故意编写了歧视性代码

- B. 训练数据反映了科技行业历史上的性别失衡

- C. 女性候选人的简历质量确实较低

- D. AI 系统的算力不足以处理所有简历

- 在向 AI 提交数据时,“最小信息原则”是指:

- A. 尽量少使用 AI 工具

- B. 只提供完成任务所必需的信息,不多给

- C. 使用最短的提示词

- D. 选择最小的 AI 模型

二、简答题

请用自己的话解释 RAG(检索增强生成)如何缓解 AI 幻觉,并说明为什么即使使用了 RAG,仍然需要人工核查。

列举算法偏见的四种来源,并各举一个生活中可能遇到的例子。

三、实操题

幻觉检测:向 DeepSeek 提出 3 个自己熟悉领域的专业问题,记录 AI 的回答,逐一核查其中的事实性错误,并统计错误类型(虚构事实/伪造引用/张冠李戴/过度自信)。

偏见检测:用 8.2 节的方法,测试 AI 对至少 5 个不同职业的描述,记录每个职业中 AI 默认使用的性别代词,分析是否存在性别刻板印象。

数据脱敏:准备一份包含个人信息的模拟数据(如班级通讯录),按照 8.3 节的方法进行脱敏处理后再提交给 AI 分析,对比脱敏前后 AI 的分析结果是否有差异。

参考答案(选择题):1-B 2-C 3-B 4-B

四、进阶挑战:辩论赛——AI 与隐私

辩题:为了公共安全(如抓捕逃犯),是否应该允许在所有公共场所部署 AI 面部识别系统?

正方:应该。安全高于隐私。只要不作恶,技术无罪。

反方:不应该。这是对公民隐私的过度侵犯。谁能保证数据不被滥用?

任务:请分别扮演正方和反方,各列出 3 个核心论点。

五、延伸阅读

- 书籍:《算法霸权》 [7] (Weapons of Math Destruction) —— 揭示大数据模型如何加剧社会不公

- 电影:《监视资本主义:智能陷阱》(The Social Dilemma) —— 了解算法如何操控我们的注意力